最近,我们的一位读者问我们如何优化 robots.txt 文件以提高 SEO。

robots.txt 文件告诉搜索引擎如何抓取您的网站,这使其成为一个非常强大的 SEO 工具。

在本文中,我们将向您展示一些有关如何为 SEO 创建完美 robots.txt 文件的提示。

什么是 Robots.txt 文件?

Robots.txt 是网站所有者可以创建的文本文件,用于告诉搜索引擎机器人如何抓取其网站上的页面并为其建立索引。

它通常存储在网站的根目录(也称为主文件夹)中。robots.txt 文件的基本格式如下所示:

| 1234567 | User-agent: [user-agent name]Disallow: [URL string not to be crawled] User-agent: [user-agent name]Allow: [URL string to be crawled] Sitemap: [URL of your XML Sitemap] |

您可以使用多行指令来允许或禁止特定 URL 并添加多个站点地图。如果您不禁止某个 URL,那么搜索引擎机器人就会假定它们可以抓取该 URL。

robots.txt 示例文件如下所示:

| 123456 | User-Agent: *Allow: /wp-content/uploads/Disallow: /wp-content/plugins/Disallow: /wp-admin/Sitemap: https://example.com/sitemap_index.xml |

在上面的 robots.txt 示例中,我们允许搜索引擎抓取 WordPress 上传文件夹中的文件并为其建立索引。

之后,我们禁止搜索机器人抓取和索引插件以及 WordPress 管理文件夹。

最后,我们提供了 XML 站点地图的 URL。

您的 WordPress 网站需要 Robots.txt 文件吗?

如果您没有 robots.txt 文件,搜索引擎仍会抓取您的网站并为其建立索引。但是,您将无法告诉他们不应抓取哪些页面或文件夹。

当您第一次创建博客并且内容不多时,这不会产生太大影响。

但是,随着您的网站不断发展并添加更多内容,您可能希望更好地控制网站的抓取和索引方式。

这就是原因。

搜索机器人对每个网站都有抓取配额。

这意味着他们在抓取会话期间抓取一定数量的页面。如果他们没有完成对您网站上所有页面的抓取,那么他们将返回并在下一个会话中继续抓取。

这可能会降低您网站的索引速度。

您可以通过禁止搜索机器人尝试抓取不必要的页面(例如 WordPress 管理页面、插件文件和主题文件夹)来解决此问题。

通过禁止不必要的页面,您可以节省抓取配额。这有助于搜索引擎抓取您网站上的更多页面并尽快将其编入索引。

使用 robots.txt 文件的另一个好理由是当您想要阻止搜索引擎对您网站上的帖子或页面建立索引时。

这不是向公众隐藏内容的最安全方法,但它将帮助您防止内容出现在搜索结果中。

理想的 Robots.txt 文件是什么样的?

许多流行的博客都使用非常简单的 robots.txt 文件。它们的内容可能会根据特定站点的需求而有所不同:

| 12345 | User-agent: *Disallow:Sitemap: http://www.example.com/post-sitemap.xmlSitemap: http://www.example.com/page-sitemap.xml |

此 robots.txt 文件允许所有机器人对所有内容建立索引,并为它们提供指向网站XML 站点地图 的链接。

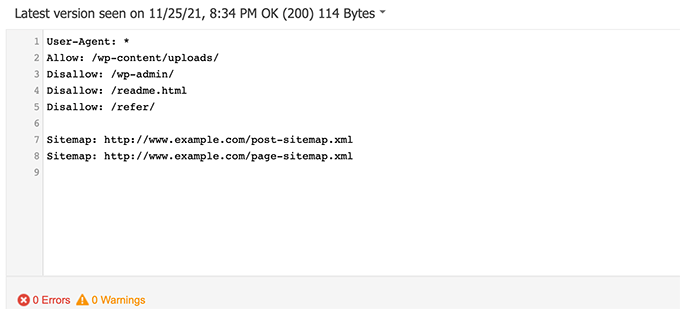

对于 WordPress 网站,我们建议在 robots.txt 文件中遵循以下规则:

| 12345678 | User-Agent: *Allow: /wp-content/uploads/Disallow: /wp-admin/Disallow: /readme.htmlDisallow: /refer/Sitemap: http://www.example.com/post-sitemap.xmlSitemap: http://www.example.com/page-sitemap.xml |

这告诉搜索机器人索引所有 WordPress 图像和文件。它禁止搜索机器人对 WordPress 管理区域、自述文件和隐藏的附属链接建立索引。

通过将站点地图添加到 robots.txt 文件,您可以让 Google 机器人轻松找到您网站上的所有页面。

现在您已经知道理想的 robots.txt 文件是什么样子了,让我们看看如何在 WordPress 中创建 robots.txt 文件。

如何在 WordPress 中创建 Robots.txt 文件

在 WordPress 中创建 robots.txt 文件有两种方法。您可以选择最适合您的方法。

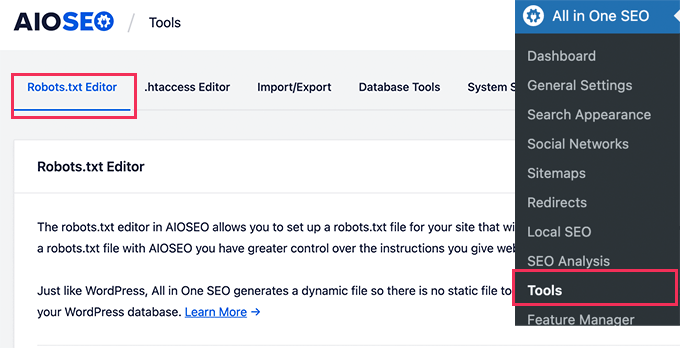

方法 1:使用多合一 SEO 编辑 Robots.txt 文件

All in One SEO,也称为 AIOSEO,是市场上最好的 WordPress SEO 插件,已被超过 300 万个网站使用。

它易于使用,并配有 robots.txt 文件生成器。

如果您尚未安装 AIOSEO 插件,您可以查看我们有关如何安装 WordPress 插件的分步指南。

注意:AIOSEO 的免费版本也可用并具有此功能。

安装并激活插件后,您可以使用它直接从 WordPress 管理区域创建和编辑 robots.txt 文件。

只需转至多合一 SEO » 工具即可编辑 robots.txt 文件。

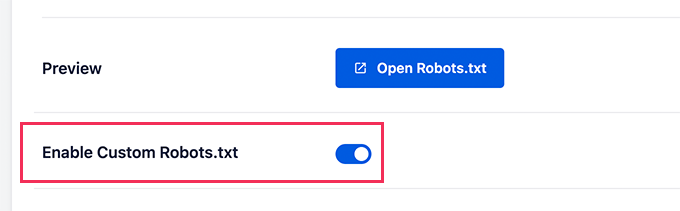

首先,您需要通过单击“启用自定义 Robots.txt”切换为蓝色来打开编辑选项。

启用此开关后,您可以在 WordPress 中创建自定义 robots.txt 文件。

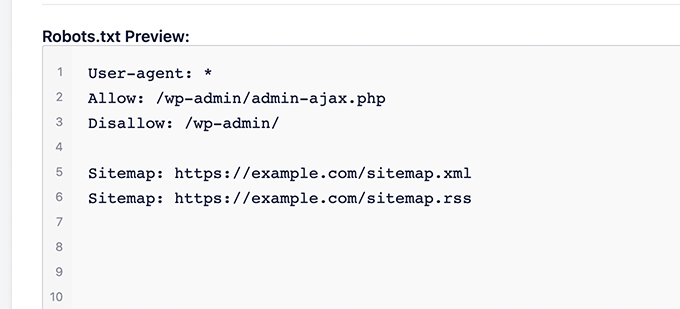

多合一 SEO 将在屏幕底部的“Robots.txt 预览”部分显示您现有的 robots.txt 文件。

此版本将显示 WordPress 添加的默认规则。

这些默认规则告诉搜索引擎不要抓取您的核心 WordPress 文件,允许机器人索引所有内容,并向它们提供指向您网站的 XML 站点地图的链接。

现在,您可以添加自己的自定义规则来改进 robots.txt 以进行 SEO。

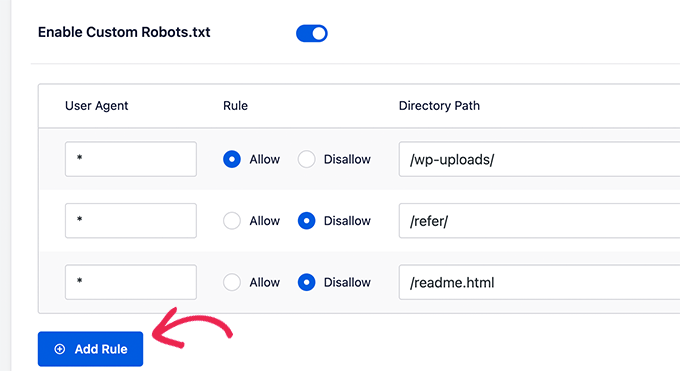

要添加规则,请在“用户代理”字段中输入用户代理。使用 * 会将规则应用于所有用户代理。

然后,选择是否要“允许”或“禁止”搜索引擎抓取。

接下来,在“目录路径”字段中输入文件名或目录路径。

该规则将自动应用于您的 robots.txt。要添加其他规则,只需单击“添加规则”按钮。

我们建议添加规则,直到您创建我们上面分享的理想 robots.txt 格式。

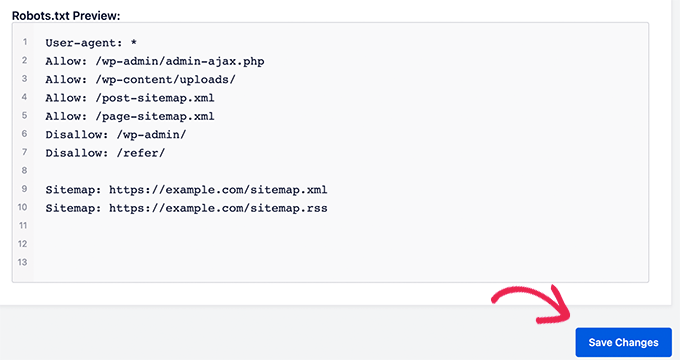

您的自定义规则将如下所示。

完成后,不要忘记单击“保存更改”按钮来存储您的更改。

方法 2. 使用 FTP 手动编辑 Robots.txt 文件

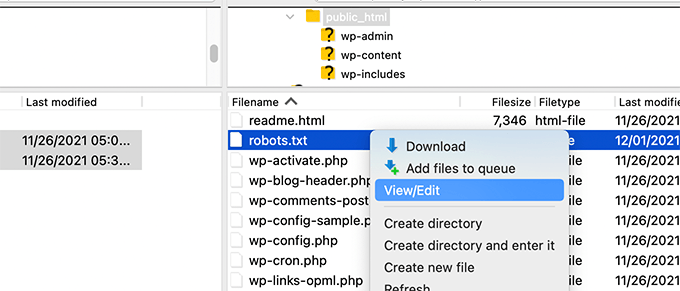

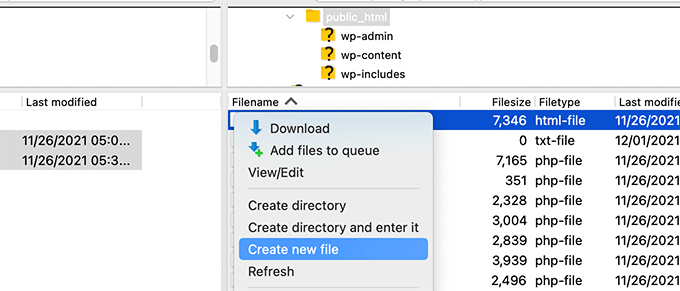

对于此方法,您需要使用 FTP 客户端来编辑 robots.txt 文件。

只需使用 FTP 客户端连接到您的WordPress 网站文件即可。

进入后,您将能够在网站的根文件夹中看到 robots.txt 文件。

如果您没有看到,那么您可能没有 robots.txt 文件。

在这种情况下,您可以继续创建一个。

Robots.txt 是一个纯文本文件,这意味着您可以将其下载到计算机上并使用记事本或 TextEdit 等任何纯文本编辑器进行编辑。

保存更改后,您可以将 robots.txt 文件上传回网站的根文件夹。

如何测试您的 Robots.txt 文件

创建 robots.txt 文件后,最好使用 robots.txt 测试工具对其进行测试。

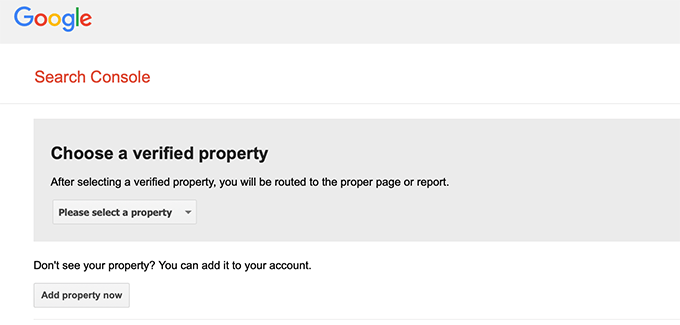

有许多 robots.txt 测试工具,但我们建议使用Google Search Console中的工具。

首先,您需要将您的网站与 Google Search Console 链接。如果您尚未执行此操作,请参阅我们有关如何将 WordPress 网站添加到 Google Search Console 的指南。

然后,您可以使用Google Search Console 机器人测试工具。

只需从下拉列表中选择您的房产即可。

该工具将自动获取您网站的 robots.txt 文件,并突出显示错误和警告(如果发现)。

最后的想法

优化 robots.txt 文件的目的是防止搜索引擎抓取非公开的页面。例如,wp-plugins 文件夹中的页面或 WordPress 管理文件夹中的页面。

SEO 专家的一个常见误区是,阻止 WordPress 类别、标签和存档页面将提高抓取速度,并导致更快的索引和更高的排名。

这不是真的。这也违反了谷歌的网站管理员指南。

我们建议您按照上述 robots.txt 格式为您的网站创建 robots.txt 文件。

我们希望本文能帮助您了解如何优化 WordPress robots.txt 文件以实现 SEO。您可能还想查看我们的终极 WordPress SEO 指南以及我们的专家精选的最佳 WordPress SEO 工具来发展您的网站。